fecha y volanta

La cumbre global de IA de las semanas pasadas en París fue un fracaso. El vicepresidente J.D. Vance se presentó en el imponente Grand Palais con una advertencia: ¡no toquen a nuestros emprendedores! Estados Unidos y el Reino Unido se negaron a firmar una declaración para garantizar que la IA sea "inclusiva y sostenible". Para algunos participantes, parecía que los líderes políticos no podían seguir el ritmo de la innovación en IA, o no querían hacerlo.

Kevin Roose, del New York Times, escribió que era como "ver a legisladores a caballo, luchando por ponerle cinturones de seguridad a un Lamborghini que pasa".

El Lamborghini parece estar ganando terreno. Cientos de millones de personas utilizan regularmente modelos de IA hoy en día, poco más de dos años después de que OpenAI lanzara ChatGPT. La velocidad de esta adopción eclipsa tecnologías igualmente disruptivas como la computadora y, según algunos, el propio internet. El auge de la IA está liderado por los "7 Magníficos", cuyo valor de mercado combinado (17 billones de dólares) representa un tercio de todo el S&P 500.

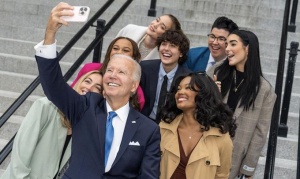

Pero los esfuerzos por regular la IA en Estados Unidos se han topado con un obstáculo. La administración Trump revocó la Orden Ejecutiva de IA de Biden, que exigía que los modelos de gran tamaño cumplieran con estándares básicos de seguridad. Como Vance anunció en París, la Casa Blanca no parece tener planes de regular la IA mediante una orden ejecutiva o legislación a corto plazo.

A nivel estatal, tampoco se está avanzando mucho en la regulación. La legislatura de California aprobó el año pasado un proyecto de ley pionero, el SB 1047, pero el gobernador Gavin Newsom lo vetó. No hay indicios de que vaya a ser revivido. Incluso los líderes de la UE, que hasta ahora han estado a la vanguardia de la regulación de la IA, están reconsiderando su histórica Ley de IA, preocupados por la posibilidad de que unas normas estrictas puedan frenar la innovación y debilitar la competitividad global.

Para muchos a quienes les gusta la idea de que un gobierno responsable moldee el desarrollo de la IA para mejorar la prosperidad y mitigar las desventajas, este parece un momento oscuro.

Al menos a corto plazo, las cosas pueden ser mejores de lo que parecen.

Cómo evitar los errores en las redes sociales: un recordatorio de lo que salió mal

Los debates actuales sobre cómo gestionar la IA se ven afectados por la incapacidad de controlar los excesos de las redes sociales. «El Congreso no supo aprovechar el momento en redes sociales», declaró el año pasado el senador de Connecticut Richard Blumenthal, uno de los principales defensores de la regulación de la IA. «Ahora tenemos la obligación de hacerlo con la IA antes de que las amenazas y los riesgos se hagan realidad».

El problema no es solo que el Congreso no "aprovechó la oportunidad" en redes sociales, sino que incentivó explícitamente a las empresas de plataformas a desarrollar algoritmos que impulsan contenido obsceno, atrayendo atención y dinero publicitario en el proceso. En 1996, el Congreso aprobó la Sección 230 de la Ley de Decencia en las Comunicaciones, que creó un escudo de responsabilidad para toda la industria de las plataformas que alojan contenido generado por los usuarios. (La semana pasada participé en el podcast "How to Fix It" de John Avlon para hablar sobre qué hacer al respecto). La Sección 230 significa que Facebook, TikTok y YouTube prácticamente no tienen responsabilidad legal por amplificar contenido peligroso, como videos de ISIS o aquellos que incitan a los adolescentes a autolesionarse. Ninguna otra industria cuenta con un escudo de responsabilidad tan amplio como este.1

A diferencia de las redes sociales, los modelos de IA no gozan de la misma protección legal, según la mayoría de los juristas . Los modelos se entrenan con cantidades enormes de datos, pero su magia reside en su capacidad para generar perspectivas casi humanas que parecen a la vez basadas en el pasado y originales.

Es casi seguro que se trata de contenido expresivo, que afortunadamente no está protegido por la Sección 230. Esto significa que, a menos que alguien proponga con éxito una nueva ley de protección de responsabilidad para la IA, la situación legal con la IA ya es mejor que la pesadilla de las redes sociales.

Por qué las leyes existentes pueden ser suficientes, a corto plazo

Los posibles daños que nos preocupan cuando se trata de IA se dividen en tres grandes categorías:

1. Abuso . Uso indebido deliberado de la tecnología para perseguir fines socialmente perjudiciales. Las personas pueden usar la IA para fomentar la violencia, el ciberacoso, la discriminación y crear y difundir desinformación, entre otras aplicaciones perjudiciales.

2. Diseño defectuoso . Garantizar que los modelos proporcionen información precisa con un sesgo mínimo, protejan la privacidad individual, respeten la propiedad intelectual y sean lo suficientemente transparentes como para generar críticas razonables.

3. Riesgo catastrófico . Uso de un modelo de IA para provocar una catástrofe nuclear o biológica. Daño excesivo, facilitado por la IA, a la estructura social, política o económica de la sociedad.

La IA puede simplificarlo todo, incluso la delincuencia. Las leyes vigentes proporcionan una estructura viable para gestionar las amenazas de las dos primeras categorías: abuso y diseño defectuoso. No nos protegen del riesgo catastrófico más preocupante.

Deber de cuidado razonable

Si una persona utiliza una tecnología para cometer un acto ilegal, es legalmente responsable del delito. Pero si una empresa no muestra la debida diligencia al ofrecer su producto o servicio, también puede ser considerada legalmente responsable.

Las empresas que desarrollan modelos de IA están sujetas a la responsabilidad extracontractual estándar, lo que significa que pueden ser consideradas responsables por negligencia si sus acciones causan daños. En un caso de negligencia, el demandante debe demostrar que el demandado incumplió un deber de cuidado. Tanto las empresas como los particulares tienen la obligación legal de actuar de forma que eviten causar daños a terceros.

El concepto de "diligencia razonable" es fundamental para determinar si se ha incumplido dicho deber. El estándar pregunta si el demandado tomó las mismas precauciones que una persona común y prudente habría tomado en circunstancias similares. Los tribunales no exigen que las empresas tomen las medidas ideales; en cambio, evalúan si las medidas adoptadas fueron razonables considerando los riesgos potenciales. Si el demandado no actuó como lo haría una persona razonable en la misma situación, la empresa o persona podría ser declarada negligente.

En casos extremos, cuando las acciones de una empresa son negligentes o intencionales, la responsabilidad legal es evidente. Por ejemplo, si ChatGPT me explicara paso a paso cómo construir una bomba, habría incumplido claramente su deber de cuidado. Esto representaría un incumplimiento de responsabilidad, dados los graves riesgos de daño que conlleva.

Un modelo de IA no puede discriminar por raza o género. Por ejemplo, Amazon desarrolló una herramienta interna de IA para analizar currículums, que inadvertidamente favoreció a los candidatos hombres debido a patrones en las prácticas de contratación anteriores de la empresa. Una vez descubierto, Amazon dejó de usar la herramienta, presumiblemente en parte para evitar responsabilidades legales. Una nueva ley de IA no resolverá el problema: la discriminación en la contratación es un problema existente que la IA podría agravar, pero ya existen sistemas legales para abordarlo.

Una IA moderna no puede crear contenido pornográfico sin consentimiento. El material pornográfico generado por IA sin consentimiento, incluyendo los deepfakes, viola las leyes de privacidad, difamación y consentimiento. Al igual que con el software de edición de fotos, crear y distribuir contenido no consensuado tiene consecuencias legales. La IA no ofrece inmunidad a los creadores, y las empresas que lo faciliten podrían ser responsables.

Una IA no puede contribuir a la producción de armas ilegales ni a actividades terroristas. Podría colaborar en actividades ilegales como la impresión 3D de armas o la planificación de un atentado terrorista, pero no las convierte en legales. Tanto las personas involucradas como los modelos de IA que facilitan dichas actividades son responsables en virtud de las regulaciones de seguridad nacional y de armas.

Estos ejemplos resaltan actividades ilegales existentes que la IA puede facilitar. Sin embargo, las cuestiones más sutiles y dependientes del contexto, como cómo entrenar los modelos de IA o si ciertos tipos de contenido son admisibles, requieren un análisis legal más matizado. Estos casos más complejos y específicos del contexto, como el uso de IA para crear videos de figuras no públicas o si se puede entrenar a estas en propiedad intelectual semipública, se abordan mejor en los tribunales. Nuestro sistema de derecho consuetudinario, que ha sentado precedentes de responsabilidad en campos como la aviación y el sector farmacéutico, puede hacer lo mismo en asuntos relacionados con la IA.

Sin duda, existen áreas donde una mayor claridad legislativa sobre cómo se aplica la legislación vigente a las empresas de IA podría ser útil. Muchas leyes existentes no fueron diseñadas para abordar las complejidades de la IA. Pero no es necesario esperar a una ley general sobre IA para saber que los modelos actuales no pueden proporcionar servicios o productos que faciliten significativamente la comisión de conductas ilegales.

Pero, pero, pero…

Si las leyes existentes y la responsabilidad civil pueden gestionar el riesgo de abuso de la IA y el diseño defectuoso de sistemas, ¿cómo deberíamos pensar en la amenaza del riesgo catastrófico ?

Un buen ejemplo es el proyecto de ley SB 1047 de California, un intento inusual y prometedor de regular proactivamente la IA, redactado por el senador Scott Wiener. El proyecto de ley generó profundas divisiones en el mundo empresarial, con el apoyo de Anthropic, respaldada por Amazon, líderes de Hollywood y Elon Musk , mientras que entre sus oponentes se encontraban la presidenta emérita Nancy Pelosi, OpenAI de Sam Altman y Marc Andreessen. Finalmente, convencieron al gobernador Newsom de que frenaría la innovación, lo que provocó su veto.

¿Qué hizo realmente el proyecto de ley? Exigió que grandes modelos de IA (cuyo entrenamiento cuesta 100 millones de dólares o más) desarrollaran un protocolo de seguridad que sería validado por un tercero y compartido con los reguladores estatales. Los planes de seguridad exigían una explicación de cómo se probaban los modelos para prevenir daños críticos y la creación de un interruptor de seguridad en caso de que algo saliera mal. Estas disposiciones se centraban en minimizar el riesgo catastrófico : la creación o el uso de armas químicas, biológicas o nucleares, o cualquier tipo de daño que pudiera causar daños por valor de 500 millones de dólares o más.

El proyecto de ley también aclaró que la legislación vigente en materia de responsabilidad civil se aplicaba a las empresas de inteligencia artificial, exigía a los desarrolladores que informaran sobre incidentes de seguridad, proporcionaba protección a los denunciantes e invertía fondos públicos en una infraestructura en la nube ampliamente accesible.

Fue un proyecto de ley excelente y el Gobernador debería haberlo firmado.

Sin embargo, el aspecto más importante fue el requisito de protocolos de seguridad exhaustivos y el registro ante el gobierno estatal. Las leyes vigentes podrían abordar muchos de los daños de la IA, de forma ex post , a posteriori. Pero también necesitamos mecanismos que puedan evitar daños catastróficos ex ante , antes de que ocurran.

Ya contamos con políticas públicas que nos ayudan a analizar cómo lograrlo. Todas las aeronaves en Estados Unidos deben registrarse en la FAA y someterse a inspecciones de seguridad periódicas. Todos los automóviles en circulación deben registrarse en el Departamento de Vehículos Motorizados y, en muchos estados, también deben someterse a inspecciones de seguridad.

De igual manera, los fondos de inversión con $150 millones o más en activos bajo gestión deben registrarse ante la Comisión de Bolsa y Valores (SEC) y presentar actualizaciones periódicas . Estas incluyen detalles sobre sus prácticas comerciales, el grado de apalancamiento que asumen y sus procesos internos para el control de flujo de fondos y contabilidad. La SEC somete a algunas de estas empresas a examen y supervisión constantes, con derecho a inspeccionar las políticas de cumplimiento, las comunicaciones internas, el material de marketing y las inversiones en cartera.

Los procedimientos de registro y las comprobaciones de seguridad pueden fomentar un equilibrio productivo entre innovación y seguridad. Un diseño adecuado permite una gran libertad en la gestión de las empresas, a la vez que garantiza que los propietarios tomen las precauciones necesarias para prevenir riesgos catastróficos. Si bien no es necesario que todos los hallazgos se hagan públicos para proteger los secretos comerciales, los reguladores deben tener acceso sin restricciones para garantizar el cumplimiento normativo. Los resúmenes públicos de estas evaluaciones pueden generar transparencia y rendición de cuentas.

Algunos argumentan que los modelos de IA deberían requerir la aprobación gubernamental antes de su implementación, de forma similar a los bancos o las farmacéuticas. No se puede lanzar un nuevo banco sin obtener previamente la autorización de un regulador estatal o de la Oficina del Contralor de la Moneda (OCC). Antes de vender un nuevo medicamento con receta, las empresas deben obtener la aprobación de la FDA. Ese enfoque sería excesivo para la IA; de hecho, podría frenar la innovación de la misma manera que Newsom preocupó al vetar la SB 1047. (Ese proyecto de ley no creó un estándar de preaprobación tan estricto).

Se debería exigir que los grandes modelos de IA se registren ante una autoridad legal existente y proporcionen evidencia detallada de sus estándares de seguridad y protocolos de prueba. Los reguladores gubernamentales podrían colaborar con agencias externas —similares a las agencias de calificación en finanzas— para investigar vulnerabilidades, descubrir riesgos y garantizar que las medidas de seguridad sean eficaces. La estructura de la legislación 1047 sigue siendo una vía prometedora, lista para ser adoptada por otras legislaturas estatales o por el Congreso.

Inversión pública

Un último punto sobre el papel de la inversión pública. El registro ayuda a garantizar un mercado seguro, pero se requieren otras medidas para impulsar la competencia y la innovación continua. Desarrollar modelos de IA de vanguardia suele costar millones de dólares, lo que crea importantes barreras para investigadores académicos y pequeñas empresas. Una nube pública , financiada con inversión pública, podría proporcionar capacidad informática accesible a investigadores y startups, facilitando la innovación y reduciendo la dependencia del capital riesgo. El proyecto de ley SB 1047 imaginó una nube pública a la que denominó CalCompute.

Existen precedentes de este enfoque a nivel internacional. Las plataformas de nube pública de China han respaldado su ecosistema de IA, y la Unión Europea está explorando inversiones similares en el marco de su Ley de IA. En Estados Unidos, la financiación federal para la investigación científica ya supera los 180 000 millones de dólares anuales, lo que demuestra la viabilidad de asignar una fracción de este presupuesto a infraestructura de nube de acceso abierto.

El enfoque de no intervención de Vance podría funcionar a corto plazo si el Congreso se resiste a extender la protección de responsabilidad de las grandes tecnológicas a la IA. Pero el gran problema que sigue sin abordarse con este enfoque es el riesgo catastrófico.

Si nuestro historial de crisis financieras, guerras mundiales y pandemias sirve de indicio, podría requerirse una catástrofe para generar la voluntad política necesaria para gestionar el riesgo a largo plazo de la IA. Esperemos que esa crisis no llegue pronto.

Newsletter

Suscribite a nuestro NewsLetter y recibí todas las noticias en tu mail

fecha y volanta